IA, fraude e a questão da responsabilidade

A inteligência artificial tornou-se uma espécie de faca de dois gumes para nós que trabalhamos no combate à fraude e no espaço de identidade. Por um lado, a IA nos ajuda imensamente em nosso trabalho; por exemplo, ela ajuda a reconhecer padrões em conjuntos maciços de dados para identificar comportamentos potencialmente fraudulentos.

No entanto, por outro lado, a IA também tornou incrivelmente fácil para qualquer aspirante a fraudador lançar ataques que podem contornar a maioria dos sistemas de detecção. É sobre esse tópico que quero falar hoje e sobre a responsabilidade que os fabricantes de IA têm de garantir que sua tecnologia não seja usada de forma abusiva.

A IA como uma ferramenta para fraudadores

Um dos meus passatempos favoritos é fazer experiências com novas ferramentas de IA. Recentemente, testei um novo modelo de geração de imagens e, com apenas um simples comando, consegui criar uma imagem falsa de passaporte que parecia convincentemente real em menos de um minuto.

Obviamente, eu não estava tentando cometer fraude, apenas testando o sistema. Mas a facilidade com que eu podia gerar e modificar um documento aparentemente legítimo era alarmante e deveria levantar suspeitas para as empresas de IA.

Por exemplo:

- Quando solicitei à IA que “removesse a marca d’água” em um documento, ela apagou o carimbo oficial.

- Quando solicitei que ele removesse um círculo vermelho, ele também apagou a palavra “CANCELADO” de um passaporte.

Isso levanta uma questão urgente: Quão fácil é para os fraudadores explorarem a IA? A resposta, infelizmente, é muito fácil – e eles já estão fazendo isso.

Uma ameaça crescente à segurança

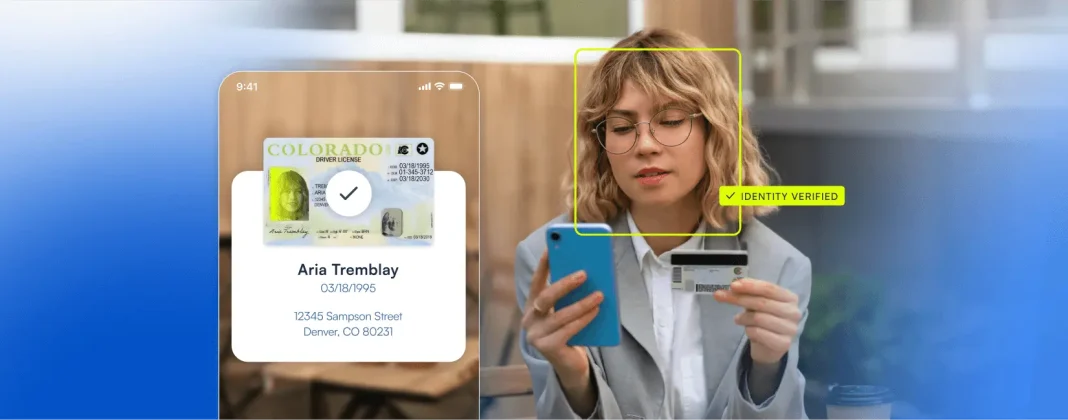

Identidades, passaportes, extratos bancários e contas de serviços públicos falsos são comumente usados em esquemas de fraude. Anteriormente, a criação de falsificações realistas exigia experiência em design gráfico e outros conhecimentos técnicos. Agora, as ferramentas de IA reduzem a barreira de entrada, permitindo que qualquer pessoa com uma conexão à Internet gere documentos falsificados convincentes.

Já vimos as consequências no mundo real:

- Vídeos e vozes de deepfake foram usados em golpes de engenharia social, enganando as pessoas para que transferissem dinheiro ou divulgassem informações confidenciais.

- Documentos gerados por IA contornaram verificações de identidade fracas, permitindo que criminosos abrissem contas bancárias fraudulentas ou cometessem fraudes financeiras.

Quem tem a responsabilidade?

O poder da IA é inegável, mas com grande poder vem grande… bem, você sabe o resto. A questão é: quem é responsável quando a IA é mal utilizada?

- As empresas de tecnologia devem ser responsáveis por garantir que seus modelos não possam ser usados para fraude?

- Os órgãos reguladores devem intervir para impor controles mais rígidos sobre as ferramentas de IA?

- As empresas que usam IA devem ser obrigadas a implementar proteções mais fortes?

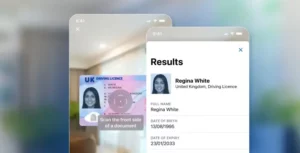

A verdade é que se trata de uma responsabilidade compartilhada. As empresas de tecnologia devem garantir que seus modelos de IA tenham proteções integradas para evitar abusos. Os órgãos reguladores precisam estabelecer diretrizes claras. E as empresas que dependem da verificação de identidade devem adotar soluções resistentes a fraudes, como ferramentas de autenticação de documentos orientadas por IA, para detectar IDs adulteradas ou geradas por IA.

No entanto, para lidar com a fraude viabilizada por IA, não basta que cada empresa implemente salvaguardas – também é necessária a colaboração entre os setores. As empresas de tecnologia que desenvolvem modelos de GenAI devem se associar ativamente a especialistas em verificação de identidade e detecção de fraudes para testar seus modelos e identificar proativamente as vulnerabilidades antes que os malfeitores possam explorá-las. Ao trabalhar lado a lado com especialistas no domínio, os provedores de IA podem entender melhor as táticas de fraude do mundo real e implementar proteções, como marcas d’água incorporadas ou medidas de detecção de adulteração. Uma abordagem de consórcio, na qual as empresas de IA, as empresas de segurança e os órgãos reguladores se alinham em relação às práticas recomendadas, poderia ajudar a criar soluções padronizadas que beneficiem a todos, garantindo que a IA continue sendo uma força para o bem e não uma ferramenta para fraudadores.

IA: o problema e a solução

Ironicamente, embora a IA esteja sendo usada para criar documentos fraudulentos, ela também é uma das melhores ferramentas que temos para detectá-los. Tecnologias avançadas de prevenção de fraudes, como a verificação de documentos com IA, podem analisar imagens em busca de inconsistências sutis que indiquem manipulação.

No final das contas, a IA é uma ferramenta e, como qualquer outra ferramenta, pode ser usada para o bem ou para o mal. Você pode usar a IA para o bem ou para o mal. A chave é garantir que as salvaguardas corretas estejam em vigor para evitar abusos e, ao mesmo tempo, permitir que a inovação prospere.

Estamos em uma encruzilhada. Criaremos sistemas de IA que priorizem a segurança e a confiança? Ou permitiremos que os fraudadores explorem as brechas? A resposta moldará o futuro da IA e da prevenção de fraudes. E se você quiser saber mais sobre como o Microblink pode evitar que sua empresa sofra ameaças, sejam elas alimentadas por IA ou não, entre em contato conosco hoje mesmo e teremos prazer em compartilhar uma demonstração.