L’IA, la fraude et la question de la responsabilité

L’intelligence artificielle est devenue une sorte d’épée à double tranchant pour ceux d’entre nous qui travaillent dans le domaine de la lutte contre la fraude et de l’identité. D’une part, l’IA nous aide énormément dans notre travail ; par exemple, elle permet de reconnaître des schémas dans des ensembles massifs de données afin d’identifier des comportements potentiellement frauduleux.

Mais d’un autre côté, l ‘IA a aussi rendu incroyablement facile pour tout fraudeur en herbe de lancer des attaques qui peuvent contourner la plupart des systèmes de détection. C’est de ce sujet que je veux parler aujourd’hui, et de la responsabilité qu’ont les fabricants d’IA de veiller à ce que leur technologie ne soit pas utilisée de manière abusive.

L’IA, un outil pour les fraudeurs

L’un de mes passe-temps favoris consiste à expérimenter de nouveaux outils d’intelligence artificielle. J’ai récemment testé un nouveau modèle de génération d’images et, à l’aide d’une simple invite, j’ai pu créer une image de passeport falsifiée qui avait l’air tout à fait réelle en moins d’une minute.

Je n’essayais évidemment pas de commettre une fraude, je testais simplement le système. Mais la facilité avec laquelle j’ai pu générer et modifier un document apparemment légitime était alarmante et devrait mettre la puce à l’oreille des entreprises spécialisées dans l’IA.

Par exemple :

- Lorsque j’ai demandé à l’IA de « supprimer le filigrane » d’un document, elle a effacé le cachet officiel.

- Lorsque je lui ai demandé de supprimer un cercle rouge, il a également effacé le mot « ANNULÉ » d’un passeport.

Cela soulève une question urgente : Est-il facile pour les fraudeurs d’exploiter l’IA ? La réponse, malheureusement, est très facile – et ils le font déjà.

Une menace croissante pour la sécurité

Les fausses cartes d’identité, les faux passeports, les faux relevés bancaires et les fausses factures de services publics sont couramment utilisés dans les systèmes de fraude. Auparavant, la création de faux réalistes nécessitait des compétences en matière de conception graphique et d’autres connaissances techniques. Aujourd’hui, les outils d’IA abaissent la barrière à l’entrée, permettant à toute personne disposant d’une connexion internet de produire des documents contrefaits convaincants.

Nous en avons déjà vu les conséquences dans le monde réel :

- Des vidéos et des voix fictives ont été utilisées dans le cadre d’escroqueries par ingénierie sociale, incitant les gens à transférer de l’argent ou à divulguer des informations sensibles.

- Les documents générés par l’IA ont contourné les faibles contrôles d’identité, permettant aux criminels d’ouvrir des comptes bancaires frauduleux ou de commettre des fraudes financières.

Qui porte la responsabilité ?

Le pouvoir de l’IA est indéniable, mais avec un grand pouvoir vient un grand… eh bien, vous connaissez la suite. La question qui se pose est la suivante : qui est responsable lorsque l’IA est utilisée à mauvais escient ?

- Les entreprises technologiques doivent-elles s’assurer que leurs modèles ne peuvent pas être utilisés à des fins frauduleuses ?

- Les régulateurs doivent-ils intervenir pour imposer des contrôles plus stricts sur les outils d’IA ?

- Les entreprises qui utilisent l’IA devraient-elles être tenues de mettre en place des mesures de protection plus strictes ?

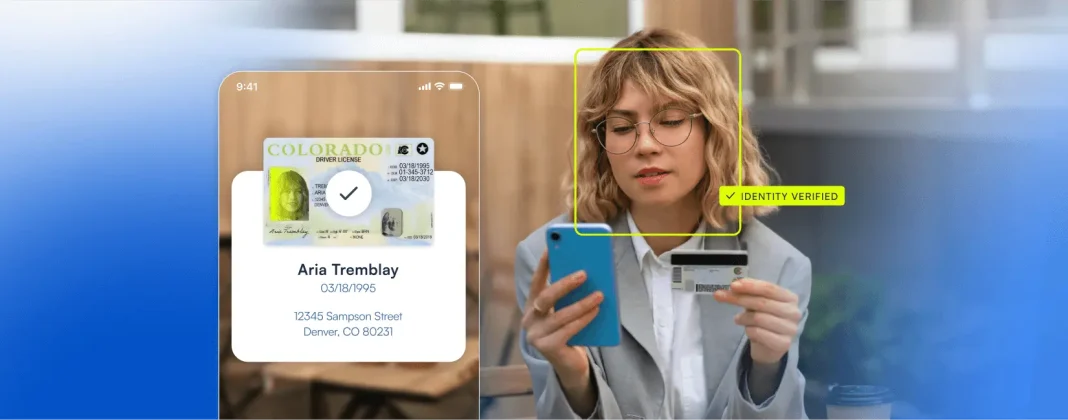

En réalité, il s’agit d’une responsabilité partagée. Les entreprises technologiques doivent veiller à ce que leurs modèles d’IA soient dotés de garanties intégrées pour éviter les abus. Les régulateurs doivent établir des lignes directrices claires. Et les entreprises qui s’appuient sur la vérification d’identité doivent adopter des solutions résistantes à la fraude, telles que des outils d’authentification de documents pilotés par l’IA, afin de détecter les pièces d’identité falsifiées ou générées par l’IA.

Mais la lutte contre la fraude basée sur l’IA ne se limite pas à la mise en œuvre de mesures de protection par les entreprises individuelles : elle nécessite également une collaboration entre les secteurs d’activité. Les entreprises technologiques qui développent des modèles de GenAI devraient s’associer activement avec des experts en vérification d’identité et en détection de fraude pour tester leurs modèles et identifier de manière proactive les vulnérabilités avant que les mauvais acteurs ne puissent les exploiter. En travaillant main dans la main avec des experts du domaine, les fournisseurs d’IA peuvent mieux comprendre les tactiques de fraude du monde réel et mettre en œuvre des mesures de protection telles que des filigranes intégrés ou des mesures de détection de la falsification. Une approche de consortium, où les entreprises d’IA, les sociétés de sécurité et les régulateurs s’alignent sur les meilleures pratiques, pourrait aider à créer des solutions standardisées qui profitent à tous, garantissant que l’IA reste une force pour le bien plutôt qu’un outil pour les fraudeurs.

IA : le problème et la solution

Paradoxalement, si l’IA est utilisée pour créer des documents frauduleux, c’est aussi l’un des meilleurs outils dont nous disposons pour les détecter. Les technologies avancées de prévention de la fraude, comme la vérification des documents par l’IA, peuvent analyser les images à la recherche d’incohérences subtiles qui indiquent une manipulation.

En fin de compte, l’IA est un outil et, comme tout outil, elle peut être utilisée à bon ou à mauvais escient. L’essentiel est de s’assurer que les bonnes garanties sont en place pour éviter les abus tout en permettant à l’innovation de prospérer.

Nous sommes à la croisée des chemins. Construirons-nous des systèmes d’IA qui donnent la priorité à la sécurité et à la confiance ? Ou laisserons-nous les fraudeurs exploiter les failles ? Si vous souhaitez en savoir plus sur la façon dont Microblink peut protéger votre entreprise contre les menaces, qu’elles soient liées à l’IA ou non, contactez-nous dès aujourd’hui et nous nous ferons un plaisir de vous présenter une démonstration.